AI

Settore finanziario nel mirino dei deepfake!

Le imprese si affidano alla verifica fotografica e audio per l'identificazione dei clienti e si attrezzano contro gli abusi tramite intelligenza artificiale generativa da parte dei truffatori.

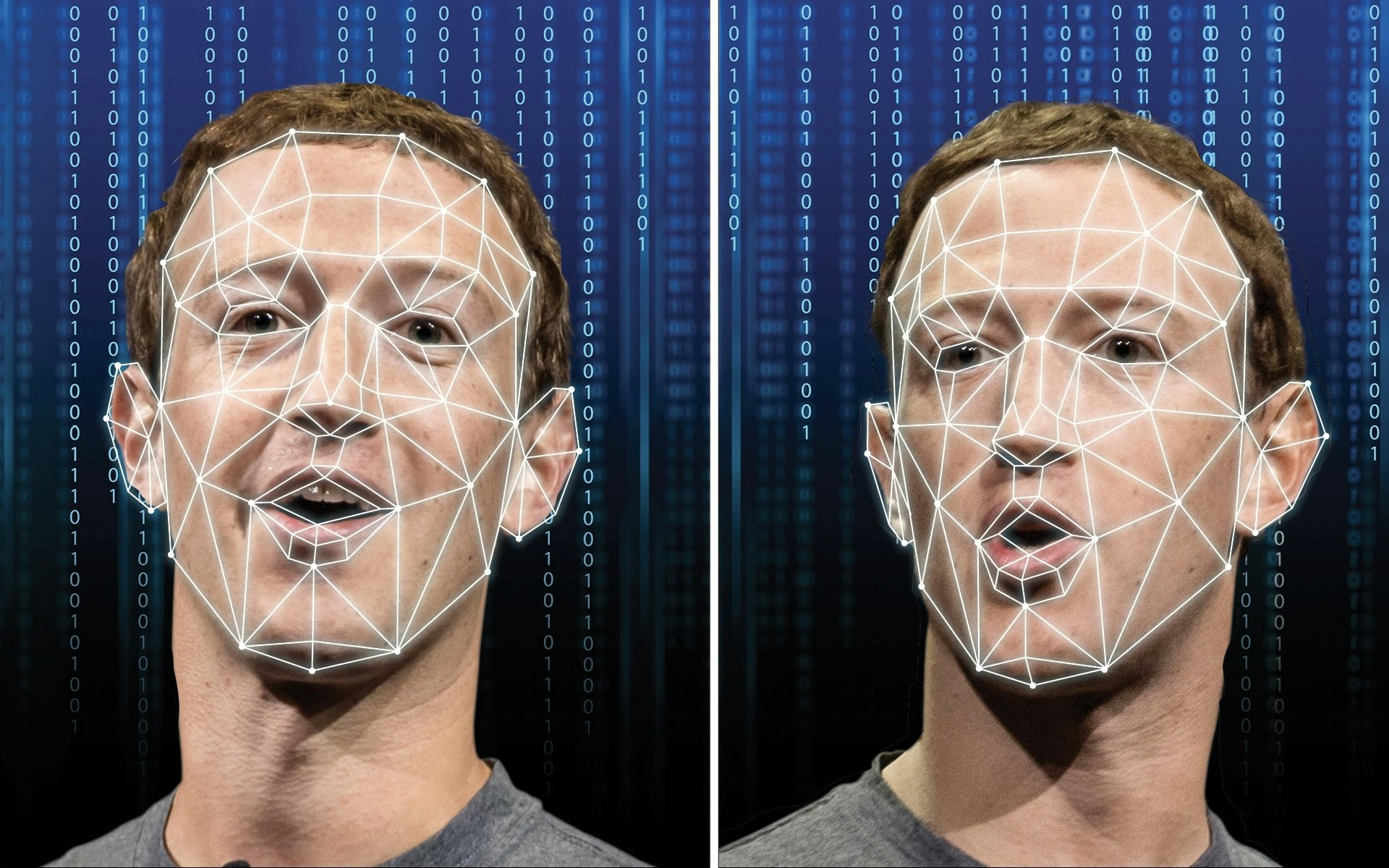

Aziende che utilizzano foto o audio per la verifica dell'identità dei clienti si preparano al rischio di inganni creati con intelligenza artificiale generativa. I deepfake, ovvero immagini o video artificiali dall'aspetto ingannevolmente reale, sono da tempo una questione presente sui social media, nelle elezioni e nel settore pubblico.

Ma con il progresso della tecnologia che utilizza l'intelligenza artificiale per imitare voci e immagini in modo più realistico che mai, i truffatori ora puntano alle aziende con i deepfake. "C'è sempre stata la presenza di chiamate fraudolente. Ma la capacità di questi modelli [AI] di imitare così bene i modelli vocali di una persona da poter dare istruzioni a qualcuno al telefono per fare qualcosa – questo tipo di rischi è completamente nuovo", afferma Bill Cassidy, Chief Information Officer presso New York Life.

Le banche e i fornitori di servizi finanziari sono tra i primi obiettivi dei truffatori. Kyle Kappel, direttore degli Stati Uniti per la Cybersecurity presso KPMG, sottolinea che questo campo si sta sviluppando molto rapidamente. Un esempio dello sviluppo rapido è la recente presentazione di una tecnologia da parte di OpenAI, capace di replicare una voce umana da un clip di 15 secondi. OpenAI ha dichiarato di non rendere la tecnologia accessibile al pubblico fino a quando non si sappia di più sui potenziali rischi di abuso.

Il timore è che i truffatori possano utilizzare file audio generati da intelligenza artificiale per ingannare i software di autenticazione vocale usati dai fornitori di servizi finanziari per la verifica dei clienti, ottenendo così accesso ai loro conti. Recentemente, la Chase Bank è stata ingannata da una voce generata tramite intelligenza artificiale. Tuttavia, la banca ha precisato che i clienti devono fornire informazioni aggiuntive per le transazioni e altre richieste finanziarie.

Incidenti di Deepfake nel Settore FinTech aumentati del 700% nel 2023 rispetto all'anno precedente, secondo un recente rapporto della piattaforma di verifica dell'identità Sumsub. Le aziende si adoperano per implementare ulteriori misure di sicurezza per prepararsi all'ondata di attacchi alimentata dall'intelligenza artificiale generativa.

Cassidy collabora, ad esempio, con il gruppo di venture capital di New York Life per identificare startup e nuove tecnologie progettate per combattere i deepfake. Alex Carriles, Chief Digital Officer della Simmons Bank, modifica alcuni protocolli di verifica dell'identità. In passato, ciò includeva il caricamento di foto delle patenti di guida da parte dei clienti. Tuttavia, poiché ora le immagini delle patenti possono essere facilmente generate con l'IA, la banca collabora con il fornitore di sicurezza IDScan.net per migliorare il processo. Invece di caricare un'immagine esistente, i clienti devono ora fotografare le loro patenti tramite l'app della banca e scattare selfie.

Non tutte le banche vedono un pericolo immediato. Amy Brady, CIO di KeyBank, dice che la sua banca è stata tecnologicamente in ritardo nell'adozione del software di autenticazione vocale. Considerando il rischio legato ai deepfake, lei ritiene retrospettivamente che ciò sia stato fortunato. Brady afferma che ha sospeso l'introduzione del software di autenticazione vocale finché non saranno disponibili migliori strumenti per smascherare le imitazioni. "A volte, paga essere in ritardo", ha detto.